只要是线上游戏,玩家之间难免会有言语冲突,而国外知名电竞游戏平台FACEIT打造的全新AI 系统,将所谓的“机器学习”应用在这个地方。他们研发出一个AI系统,可以用来对付在线上对战游戏中常常在聊天室口出恶言的玩家们。

FACEIT、Google Cloud与Jigsaw(前身为Google Labs)展开技术合作,一同打造了这个能够侦测并且封锁这些恶意玩家言论的AI,目前这个系统已经正式实装,迄今为止,官方宣布他们已经封锁了超过2万位违规的《反恐精英:全球攻势》(Counter-Strike: Global Offensive;CS:GO)玩家。

这个AI的名称为“Minerva”,在经过了好几个月的调整测试,将误判率降到最低之后,该系统正式在今年8月于FACEIT自家电竞游戏平台中实装。在那之后,这个AI寄出了9万笔警告,并且封锁了《CS:GO》2万位在聊天室口出恶言或是洗频的玩家,完全没有经过人为手动介入。

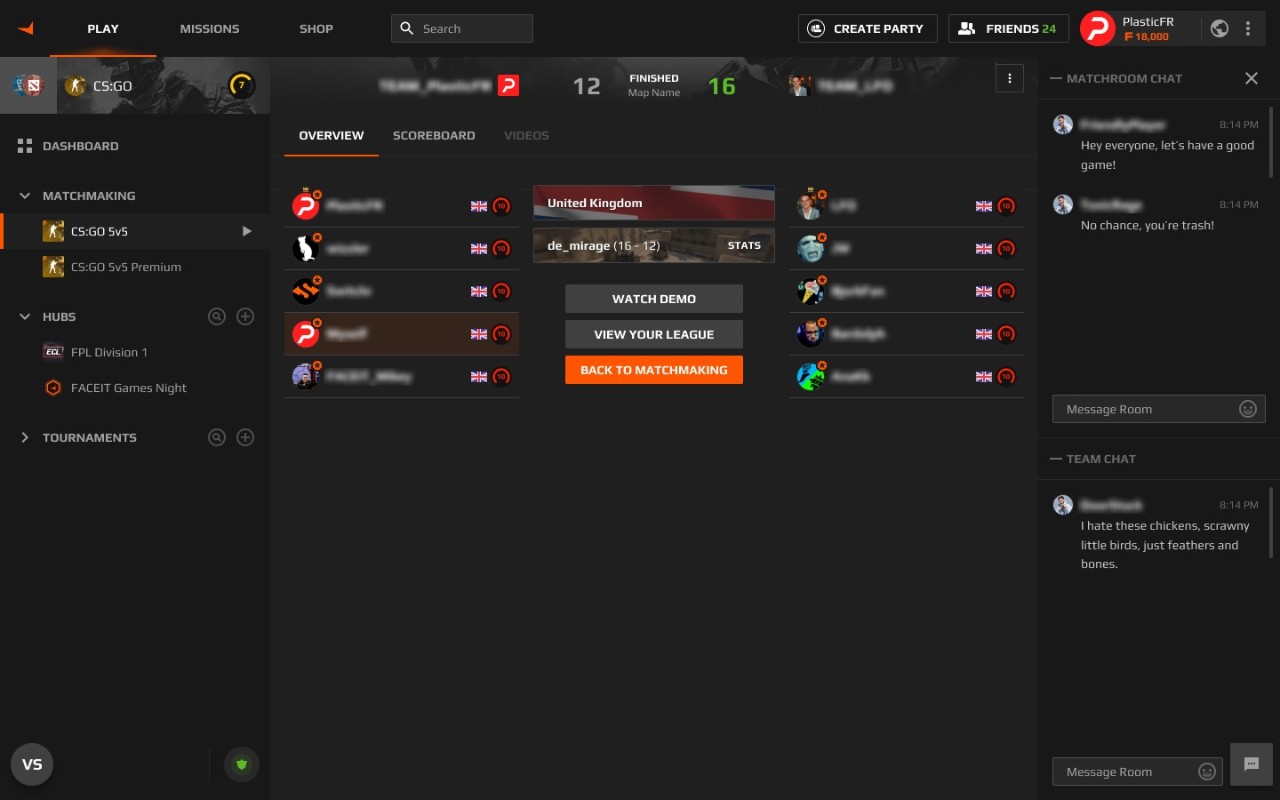

“如果一则信息在侦测了对话的前后文,并被判定为恶意言论之后,Minerva就会向该玩家发出『攻击性言论』的警告。”FACEIT 在部落格贴文中解释:“在聊天室中被判断为垃圾信息的内容也一样。Minerva在每场对战结束后的几秒内就能够做出判断,如果它侦测到了违规言论,系统就会自动发出警告,或是直接封锁违规的玩家。”

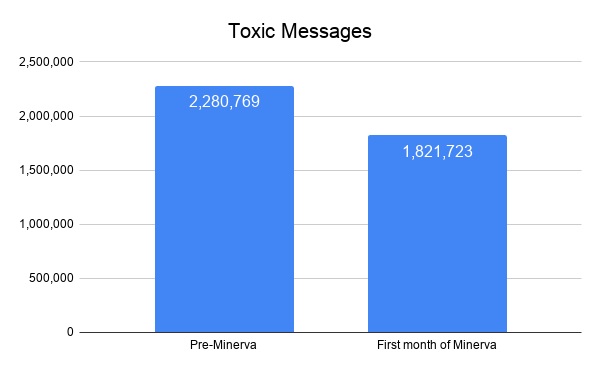

简单来说,这个由FACEIT平台与Google联手打造的全新AI系统,在上线的一个月内已经封锁了2万位口出恶言的《CS:GO》玩家。而在这个AI实装之后,在八月到九月这段期间内出现的恶意言论已经降低了20%左右,而会传送这类言论的玩家数量也减少了8%。

“侦测游戏中的聊天室,对于Minerva来说只是最初也是最简单的应用方式,也是一种个案研究法,这能够作为我们对于这个AI的愿景所踏出的第一步。”

FACEIT在博客中表示:“我们对于目前的基础都感到相当兴奋,这也代表了一种能够让我们不断改进Minerva的庞大基数,直到我们终于能够瞬间侦测并处理任何形式的违规行为。而在接下来的几周内,我们也会宣布全新的系统,借此用来支持Minerva的训练。”

粮食供给安全的要求越来越高

粮食供给安全的要求越来越高

2022年服贸会增加赞助商层级

2022年服贸会增加赞助商层级

高标准自贸区网络加快打造

高标准自贸区网络加快打造

GDP万亿城市进入新一轮的升

GDP万亿城市进入新一轮的升

长沙实现数字人民币税款缴纳

长沙实现数字人民币税款缴纳

新车销售由增量市场逐步转向

新车销售由增量市场逐步转向

48小时点击排行

48小时点击排行